在不同DL硬件上部署各种深度学习模型,促进了社区深度学习编译器的研发。从行业和学术界已经提出了几个DL编译器,如Tensorflow XLA和TVM。同样,DL编译器将不同DL框架中描述的DL模型作为输入,然后为不同的DL硬件生成优化的代码作为输出。然而,现有的调查没有全面分析DL-编译器的独特设计。在本文中,我们对现有DL编译器进行了全面调查,对常见设计进行了详细剖析,重点介绍了面向DL的多级IR和前端后端优化。从不同方面,我们对现有DL和编译器进行了全面的比较。此外,我们还详细介绍了多级IR设计和编译器优化技术。最后几个见解被突出显示为DL编译器的潜在研究方向。这是一份重点介绍DL编译器独特设计的最值得关注的调查论文,我们希望,这能为未来DL编译器的研究铺平道路。

现今存在的开源协议很多,而经过Open Source Initiative组织通过批准的开源协议目前有58种。我们现在常见的开源协议如BSD, Apache,GPL, LGPL,MIT等都是OSI批准的协议。如果要开源自己的代码,最好也是选择这些被批准的开源协议。今天介绍几种常见的开源软件协议。

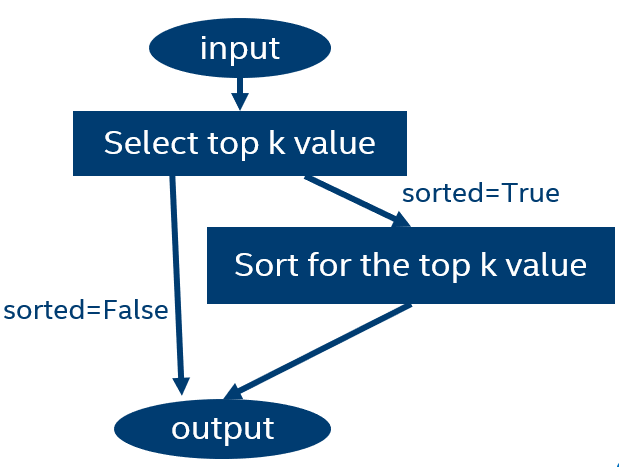

topk(input, k, dim=None, largest=True, sorted=True, out=None) -> (Tensor, LongTensor)

Semantics:

Returns the :attr:k largest elements of the given :attr:input tensor, a long a given dimension.

Introduction to GPGPU

Why program GPUs

CPU VS GPU architecture

General GPU programming tipsSYCL for OpenCL

Overview

FeaturesSYCL example

Vector add

这篇文章用来记录总结深度学习领域常见面试题。题目来源于各大门户网站和招聘网站。一来用于了解当前面试常考热点问题,二来在工作闭门造车的同时,弥补下自己深度学习理论方面的不足。

最近在跑某个深度学习的模型训练时,发现训练时采用的batch size对训练的效果有一定的影响,因此这里想要做个总结。这篇文章也是参考了知乎上面几位网友的答案:

原文链接:https://www.zhihu.com/question/32673260/answer/71137399

原文链接:http://baijiahao.baidu.com/s?id=1663496784360695202

罗永浩的回归依然万众瞩目。

4月1日直播首秀结束后,比起他自己的内心世界,外界对他的情感和评价或许更丰富也更复杂:支持、感动、激动,鄙夷、质疑、嘲讽,这些字眼全都混杂到一起,重新建立罗永浩的舆论形象。

他的主播身份越来越鲜明,但不疑有他的是,关注他的人一刻也没有忘记他走过的那条路,以及路途上发生的故事。

volatile关键字是一种类型修饰符,用它声明的类型变量表示可以被某些编译器未知的因素更改,比如:操作系统、硬件或者其它线程等。遇到这个关键字声明的变量,编译器对访问该变量的代码就不再进行优化,从而可以提供对特殊地址的稳定访问。